OpenAI a introduit o1-mini, un nouveau modèle IA optimisé pour un raisonnement à faible coût. o1-mini excelle dans les domaines STEM, en particulier les mathématiques et la programmation, atteignant des performances presque équivalentes à o1 sur des benchmarks tels que AIME et Codeforces.

Capacités clés

- Raisonnement avancé: Le modèle o1-Mini excelle dans les tâches nécessitant des capacités de raisonnement logique et de résolution de problèmes, ce qui le rend adapté aux applications complexes dans STEM domaines STEM. Il est optimisé pour gérer les requêtes complexes, fournissant des réponses comparables à celles d’experts humains avancés dans les tâches de référence.

- Compétence en codage: Ce modèle est particulièrement efficace pour les tâches de développement de logiciels, notamment :

- Génération de code : génère rapidement des extraits de code basés sur des descriptions en langage naturel.

- Résolution de bogues : identifie et corrige rapidement les erreurs dans le code existant, améliorant ainsi la productivité des développeurs.

- Performance sur les benchmarks : Démontre de solides performances dans les défis et compétitions de codage, tels que Codeforces, mettant en valeur sa capacité à résoudre efficacement les problèmes de programmation.

- Calculs mathématiques: Le o1-Mini peut effectuer des calculs mathématiques rapides et précis, ce qui en fait un outil idéal pour le soutien académique et la recherche où des calculs précis sont essentiels.

- Capacité de jetons élevée: avec la capacité de gérer jusqu’à 128K jetons pour l’entrée et 65,5K jetons pour la sortie, o1-Mini peut gérer des tâches étendues de génération et de traitement de texte, ce qui est bénéfique pour les applications nécessitant de grands ensembles de données ou des interactions détaillées.

Prix et accessibilité d’OpenAI o1-Mini

Le modèle o1-Mini est environ 80 % moins cher que son prédécesseur, ce qui en fait une option viable pour les startups, les établissements d’enseignement et les petites entreprises qui cherchent à tirer parti de l’IA sans encourir de coûts élevés. Sa conception donne la priorité à la vitesse tout en maintenant des capacités de raisonnement robustes, offrant ainsi un équilibre entre performances et abordabilité. Voici un aperçu détaillé de leurs prix et de leur accessibilité.

Structure de prix

- Coût d’entrée : 3,00 $par million de jetons

- Coût de sortie : 12,00 $par million de jetons

- Coût de l’entrée mise en cache : 1,50 $par million de jetons.

Accessibilité

- Plans ChatGPT:

- Les utilisateurs disposant d’un ChatGPT Plus ou Team peuvent accéder aux modèles o1 et o1-Mini, avec des limites de 50 messages par semaine pour o1 et de 50 messages par jour pour o1-Mini.

- Le nouveau plan ChatGPT Pro offre un accès presque illimité à ces modèles, favorisant une utilisation plus large dans divers secteurs, y compris l’éducation et les startups qui ont besoin de solutions IA fiables sans coûts élevés.

Applications et capacités

o1-mini est actuellement disponible pour les utilisateurs de l’API de niveau 5 à un coût 80 % inférieur à celui de o1-preview. Les utilisateurs de ChatGPT Plus, Team, Enterprise et Edu peuvent utiliser o1-mini comme alternative à o1-preview, avec des limites de fréquence plus élevées et une latence plus faible. o1-mini prend en charge l’entrée et la sortie de texte, avec une fenêtre contextuelle de 128 000 et une limite de sortie de 64 000.

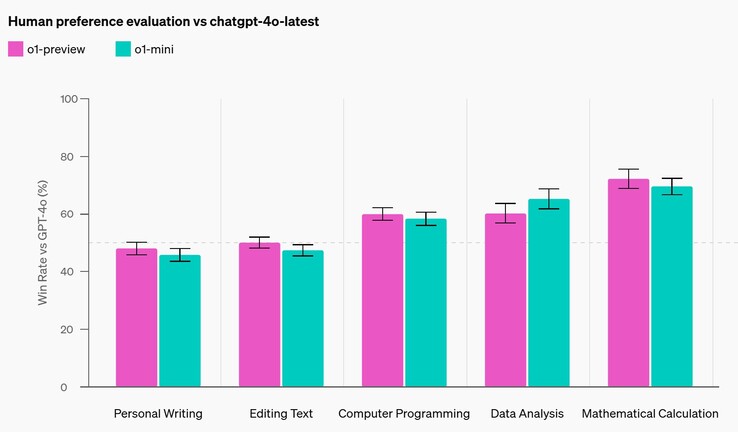

OpenAI o1-preview et o1-mini

o1-preview

- Modèle le plus performant de la série o1: cette variante gère probablement des tâches complexes qui nécessitent un raisonnement approfondi et une compréhension avancée. Il excelle dans des domaines tels que la compréhension du langage naturel, la résolution de problèmes et l’offre de réponses plus nuancées, ce qui le rend adapté aux scénarios où la profondeur et la précision priment sur la vitesse ou l’efficacité.

- Capacités de raisonnement améliorées: cela suggère que le modèle peut effectuer des tâches impliquant la déduction logique, la reconnaissance de formes et peut-être même la prise de décision basée sur l’inférence mieux que les autres modèles de la série o1. Il convient aux applications de recherche, d’analyse de données avancée ou aux tâches qui nécessitent une compréhension sophistiquée du langage, comme répondre à des requêtes complexes ou générer un contenu détaillé.

O1-Mini

- Plus rapide et plus rentable: cette version est optimisée pour la vitesse et une moindre utilisation des ressources de calcul. Elle troque probablement certaines capacités de raisonnement avancées en échange de meilleures performances dans les situations où les réponses rapides sont plus importantes que la profondeur. Cela en fait une option plus économique lorsqu’une utilisation à grande échelle est nécessaire, comme lors de la gestion de nombreuses demandes en parallèle ou pour des tâches plus simples qui ne nécessitent pas de calcul lourd.

- Idéal pour les tâches de codage: Le o1-Mini semble être spécialement conçu pour les tâches liées au codage, telles que la génération de code, la correction de bogues ou les scripts de base. Son efficacité et sa rapidité en font un bon choix pour une itération rapide, où les utilisateurs peuvent générer ou déboguer du code rapidement sans avoir à attendre des processus de raisonnement complexes.

- Consommation de ressources réduite: cela signifie que le modèle utilise moins de mémoire et de puissance de traitement, ce qui peut aider à réduire les coûts opérationnels, en particulier dans les déploiements à grande échelle où plusieurs instances du modèle peuvent s’exécuter simultanément.

| Métrique / Tâche | o1-mini | o1-aperçu |

| Math (AIME) | 70.0% | 44.6% |

| Raisonnement STEM (GPQA) | Surpasse le GPT-4o | Supérieur à o1-mini |

| Codeforces (Elo) | 1650 (86e centile) | 1258 (en dessous de o1-mini) |

| Sécurité Jailbreak | 0,95 sur les jailbreaks d’origine humaine | 0.95 |

| Vitesse | 3-5x plus rapide que le GPT-4o | plus lent |

| HumanEval (codage) | Compétitif avec o1 | Retard dans certains domaines |

| Connaissances non STEM | Comparable au GPT-4o mini | Connaissance du monde plus large |

o1-mini est idéal pour les utilisateurs qui ont besoin d’un modèle très efficace et rapide optimisé pour le raisonnement STEM, le codage et les temps de réponse rapides, tout en étant rentable.

o1-preview convient mieux à ceux qui ont besoin d’un modèle plus équilibré avec des connaissances non STEM plus larges et des capacités de raisonnement robustes dans un plus large éventail de domaines.

Le choix entre o1-mini et o1-preview dépend en grande partie du fait que vous vous concentrez sur des tâches STEM spécialisées ou sur des tâches world-knowledge-driven plus générales.